Deepfake-Skandal: Taylor Swift ist nicht das erste Opfer

Ein Deepfake-Nackfoto von Taylor Swift wurde auf X rund 45 Million Mal angezeigt, bevor es gelöscht wurde. Sie ist nicht die Erste, die es trifft.

Als die künstlich generierten, expliziten Bilder von Taylor Swift auf X (ehemals Twitter) viral gingen, war das Entsetzen gross.

Millionen ihrer Fans versuchten, die KI-generierten Bilder mit Posts unter dem Motto «Schützt Taylor Swift» zu überfluten und so aus den Trends zu drängen.

Doch trotz dieser Bemühungen liess sich nicht verhindern, dass der Skandal jeden grossen Medienkanal erreichte.

Prominente im Visier von KI

Die Aufregung um Taylor Swift ist beunruhigend, aber das Ereignis keineswegs ein Einzelfall. Aus den letzten Jahren könnte man mehrere Fälle von Prominenten und Influencern aufzählen, deren Image durch KI-generierte Inhalte unangenehm angekratzt wurde.

Und das fängt vermutlich gerade erst an. Mit nur einem kurzen Video als Input kann man heutzutage ein komplett neues Video erstellen lassen (!), dessen Dialoge schlicht vom Skript kommen.

Was Spass macht, wenn man sich selbst klonen möchte. Aber tendenziell gemein wird, wenn jemand anders so ein Video mit Ihnen als Hauptdarsteller macht, ohne dass Sie davon wissen und das Sie im schlimmsten Fall öffentlich zu Unrecht in den Dreck zieht.

Zweimal hinsehen – nur wohin?

In dem Mass, in dem es immer mehr KI-Tools zur Erstellung solcher Deepfake-Inhalte gibt, wächst auch die Menge an irreführenden Bildern und Videos im Internet, und zwar rasend schnell.

Doch wie können wir (Menschen!) unterscheiden, was echt ist und was nicht?

Jeder ist potenzielles Opfer – oder Täter

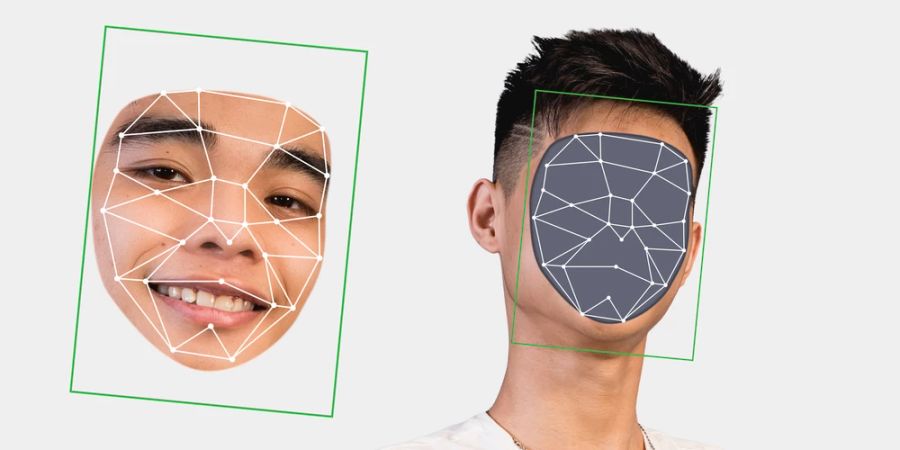

Deepfakes sind künstlich generierte Bilder, Videos oder Audiodateien von Personen, die mithilfe von Deep-Learning-Technologie erstellt werden. Am Anfang hatte man zum Beispiel gern Bilder einer Person über das einer anderen in bereits produzierten Clips gelegt; wem das gelang, der musste einiges an Wissen über Technologie anwenden können.

Das ist heute anders. Dank textbasierter generativer KI-Technologien kann fast jeder realistisch manipulierte Inhalte erstellen. Gerne werden Schauspieler oder Politiker dann in untypischen oder ausschlachtbaren Situationen dargestellt, um Internet-Nutzer zu täuschen und selbst Profit daraus zu schlagen.

Ganz zu schweigen von Sicherheitssystemen, die für schlaue Hacker gern genommenes Ziel ihrer Aktivitäten sind.

Schlechte Karten für die Demokratie

In einer Umfrage von McAfee aus dem Jahr 2023 gaben 84 Prozent der US-Amerikaner an, dass sie mit Blick auf das kommende Jahr Sorge hätten, wo noch überall Deepfakes zum Einsatz kommen könnten.

In Deutschland haben laut Bitkom zwar «nur» 63 Prozent der Menschen Anst vor Deepfakes. Dafür konstatiert ein grosses Medium der Schweiz, dass die Demokratie auch durch Fake News in Gefahr sei, insbesondere auch mit Blick auf die Medienkompetenz junger Menschen.

Während Experten wie Regierungen daran sitzen, zu überlegen, wie Deepfake-Inhalte zu verhindern sind, ist schon jetzt klar: Die Deepfake-Entwicklung geht gerade erst los. Begründeter Sorge sollten also schnellstmöglich effektive Ansätze zur Deepfake-Bekämpfung folgen.