Diese Deepfake-Schwachstellen sollten Sie kennen

Deepfakes, die täuschend echte Bilder und Videos erzeugen, werden immer ausgefeilter. Umso wichtiger, zu wissen, woran man sie erkennen kann.

KI-Systeme wie DALL-E 2 oder Midjourney sind in der Lage, auf Basis von Textbeschreibungen neue Bilder zu generieren. Vom fotorealistischen Porträt bis zum Cartoon-Stil ist alles möglich.

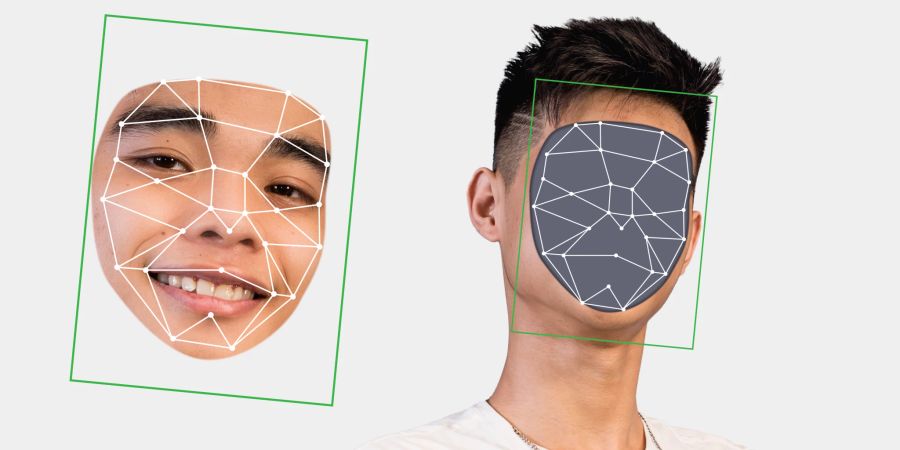

Wenn Sie nicht mehr Sie selber sind

Diese KI-Modelle können nun auch mit solchen Apps kombiniert werden, die Personen auf Bildern und Videos automatisch erkennen. Das Ergebnis ist ein digitales Spezialeffektstudio im Taschenformat, mit dem Gesichter oder ganze Körper nahezu unsichtbar ausgetauscht werden können.

Wer weitere generative KIs hinzuzieht, kann sogar Stimmen nachbilden. Auf Fotos und Videos wirkt es dann, als wäre jemand an einem Ort gewesen, obwohl das nicht der Fall war.

Trotz ihrer beeindruckenden Leistungsfähigkeit haben auch Generative-KI-Systeme ihre Schwachstellen. In den ersten Generationen dieser Technologie gab es auffällige Fehler.

Daran erkennen Sie Deepfakes

Achten Sie auf Details: Sind unregelmässige Objekte – wie eine Hand oder ein Ast – an einem «falschen» Ort?

Schauen Sie genau hin, wo ein Objekt über ein Gesicht verläuft. Oft offenbaren sich nämlich genau hier Ungereimtheiten, beispielsweise schimmert das ursprüngliche Gesicht durch.

Sind die Farben, Schatten und Hintergründe stimmig? Achten Sie auf Dinge, die unmöglich oder bizarr wirken könnten – seltsame Hände oder sogar zu viele Arme sind solch verräterische Hinweise.

Tools zur Authentifizierung

Je besser die Software zur Bearbeitung von Fotos und Videos wird, desto einfacher wird es, Fake-News und Deepfakes zu erstellen, die kaum als solche zu erkennen sind.

Denn natürlich wissen auch tüftelnde Ingenieure von diesen Schwachstellen und arbeiten mit Hochdruck daran, diese auszubügeln. Unternehmen wie Adobe arbeiten aber bereits ebenfalls daran, Lösungen zu entwickeln, die auf einer Augenhöhe mit den Deepfakes sind und mit denen sich echte Inhalte von gefälschten unterscheiden zu können.

Bleibt zu hoffen, dass sie damit Erfolg haben werden, und die Tools für alle User frei zugänglich gemacht werden!